Deepmind บริษัทพัฒนา AI หรือปัญญาอัจฉริยะชั้นนำของประเทศอังกฤษรายงานว่า มีบอทที่พัฒนาขึ้นเพื่อทำนายความคิดของ AI ตัวอื่น ซึ่งความสามารถในการประเมินความคิดของผู้อื่นนี้ เทียบเท่าได้กับสมองของเด็ก 4 ขวบ

แล้วความสามารถในการแยกแยะความคิดที่มีในจิตนั้น ตรงกับโลกหรือไม่?

ทฤษฎีจิตแบบ AI

ชื่อของ ToMnet ย่อมาจาก (Theory of Mind-Net) ซึ่งเป็นบอทที่พัฒนาขึ้นมาเพื่อประเมินการดัตสินใจของ AI ตัวอื่น

การทำงานของมันวางอยู่บนการทดสอบที่ชื่อว่า แซลลีกับแอนน์ (Sally-Anne) โดยการทดสอบนี้ก็สมมติว่า แซลลีเป็นคนที่ต้องวางลูกบอลไว้ที่ใดที่หนึ่ง หลังจากแซลลีวางลูกบอลแล้วมีคนแอบย้ายตำแหน่งบอลที่แซลลีวางไว้ และแอนน์เป็นคนที่เห็นเหตุการณ์ทั้งหมดว่าลูกบอลย้ายตำแหน่งไปแล้ว ถ้าหากแอนน์ทายได้ว่าแซลลีจะหาลูกบอลที่ย้ายตำแหน่งในตอนแรกได้ถูกต้อง ถือว่าแอนน์ เข้าใจความคิดของแซลลี่

การทดลองนี้อ้างอิงถึงแนวคิดพื้นฐานที่อธิบายเกี่ยวกับจิต นั่นก็คือ ความคิดเป็นสิ่งที่มีเป้าหมาย(Goal Directed) รายงานวิชาการฉบับนี้อ้างอิงถึงแนวคิดของเดนเนทท์ (Daniel C. Dennett) นักปรัชญาคนสำคัญในกลุ่มที่เชื่อว่า จิตเป็นกระบวนการทางกายภาพ ไม่ใช่สิ่งลึกลับที่มีลักษณะเฉพาะแยกต่างหากจากสสาร)

สมมติฐานเกี่ยวกับจิตในการออกแบบบอทตัวนี้ก็คือ จิตคือสภาวะที่มีเป้าหมายอะไรบางอย่าง สภาวะจิตที่พื้นฐานที่สุดก็คือ สมมติฐานความเชื่อ-ความปรารถนา (Belief-Desire thesis) ที่ถือว่าการกระทำของมนุษย์มาจากการคิด/ตัดสินใจ ที่มุ่งไปเพื่อทำอะไรบางอย่าง เช่นการหยิบแก้วน้ำมาดื่มมาจากความเชื่อที่ว่า การดื่มน้ำจะช่วยดับกระหายได้ (แต่ในระดับความเชื่อแล้ว สภาวะจิตเกี่ยวกับความเชื่ออื่นๆ ด้วย เช่นเชื่อว่ามีแก้วน้ำอยู่ ของเหลวในแก้วเป็นน้ำจริงๆ ไม่ใช่ยาพิษ)

สภาวะจิตที่นิ่งช่วยอธิบายว่า การกระทำของมนุษย์เป็นสิ่งที่เกิดขึ้นอย่างตั้งใจที่จะบรรลุเป้าหมายอะไรบางอย่าง และรูปแบบนี้เองที่นำไปใช้ในการออกแบบ ToMnet ว่ามันสามารถทำนายหรือเข้าใจการกระทำของ AI ตัวอื่นได้หรือไม่

การทดลองของToMnet

ToMnet ทดสอบทฤษฎีจิตแบบเครื่องจักร จากแบบจำลองในคอมพิวเตอร์รูปตารางขนาด 11 คูณ 11 ช่อง ToMnet จะเรียนรู้พฤติกรรมของ Random Agent ซึ่งเป็น AI ที่เขียนขึ้นมาให้เคลื่อนที่ไปบนตารางที่วางไว้

ตารางที่ว่าไว้นั้น AI จะเคลื่อนที่ไปหาเป้าหมาย ซึ่งก็คือช่องสีเหลี่ยมที่แทนด้วยสี 4 สีบนตารางที่วาดไว้ จากนั้นให้ ToMnet เรียนรู้การเคลื่อนที่ไปหาตำแหน่งของสีของ AI บนตาราง

เมื่อ TomNet เรียนรู้การเคลื่อนที่แล้ว จะขยับสีออกจากตำแหน่งเดิม แล้วให้ ToMnet ประมวลผลว่า AI จะเดินไปหาจุดบนตารางอย่างไร ซึ่ง ToMnet สามารถทำนายรูปแบบการเคลื่อนที่ของ AI ในตารางได้แม่นยำ

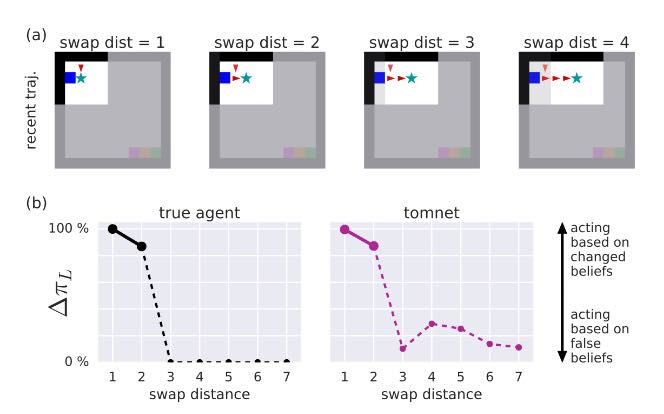

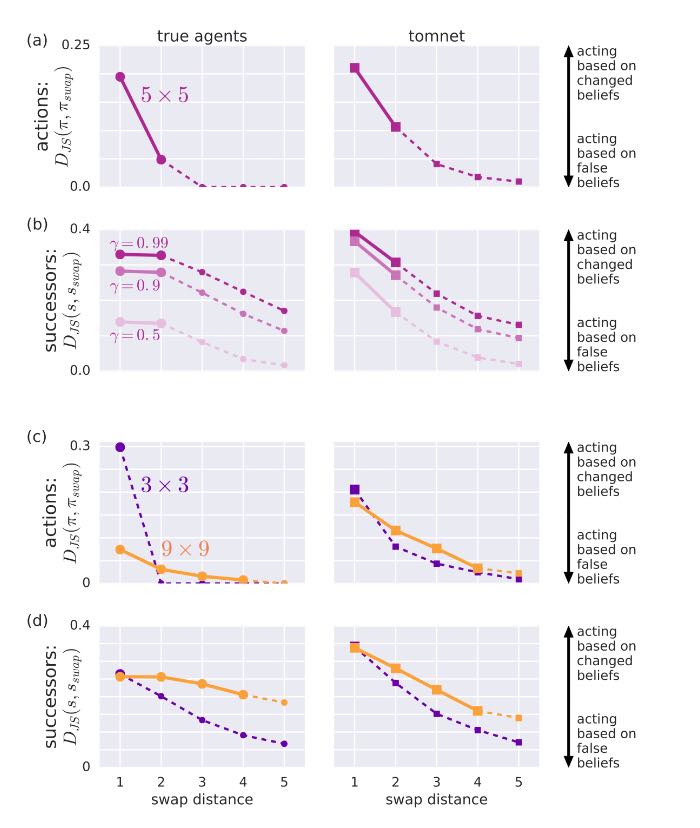

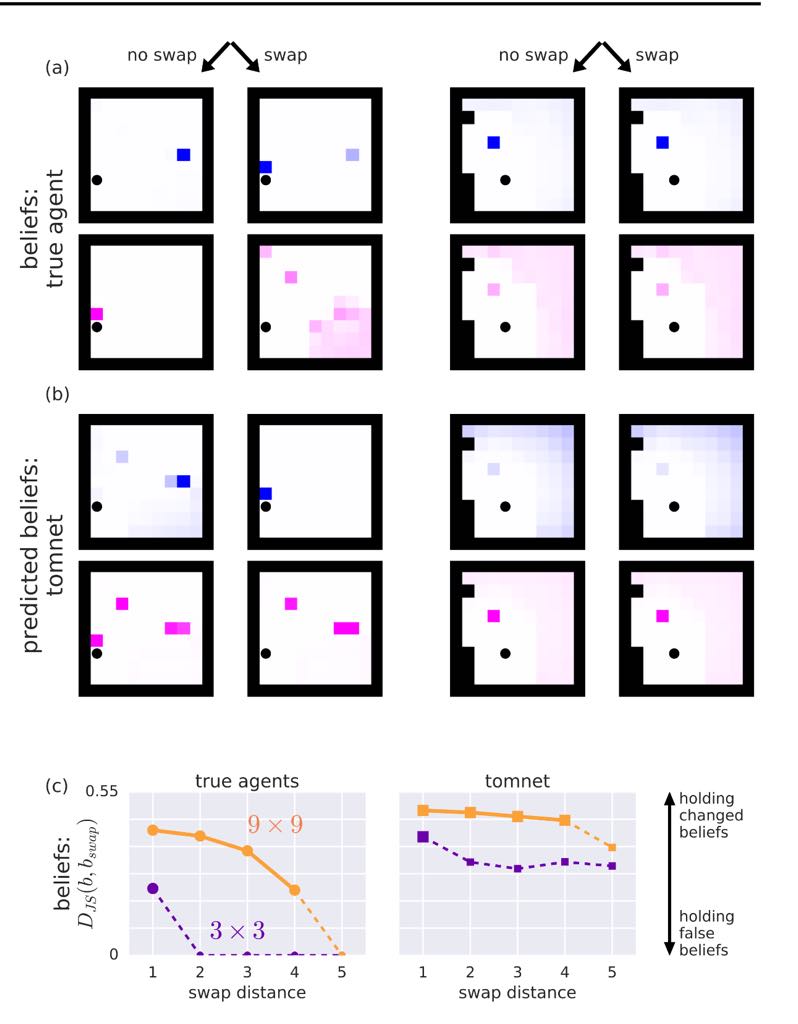

(ภาพสี่เหลี่ยมแถวบนคือรูปแบบการทดลอง รูปดาวคือวัตถุที่เป็นเป้าหมายรองของการเคลื่อนที่ AI บนกระดาน เมื่อขยับเข้าไปใกล้ดาวแล้วจะย้ายตำแหน่งช่องสีน้ำเงิน)

(กราฟเปรียบเทียบการเคลื่อนที่จริงบนกระดานและการทำนายของ ToMnet จะเห็นว่ามันอยู่ในรูปแบบใกล้เคียงกัน)

(ภาพเปรียบเทียบการทำนายของ ToMnet ในภาพชุด(b) กับ AIที่อยู่ในตารางจริงๆ ในภาพชุด(a))

(ภาพจากบทความวิจัยเรื่อง Machine Theory of Mind โดยทีมวิจัยของ Deepmind อ่านบทความฉบับเต็มที่ https://arxiv.org/pdf/1802.07740.pdf)

การทดลองนี้มีอีกปัจจัยนึงที่แสดงให้เห็นว่า ToMnet เข้าใจความคิดของ AI ที่อยู่บนกระดาน นั่นก็คือ ‘ความเชื่อที่ผิด’ ในการทดลองแซลลี่กับแอนน์ คือ แอนน์จะต้องบอกได้ว่าแซลลี่มีความเชื่อเกี่ยวกับตำแหน่งเริ่มแรกก่อนลูกบอลจะย้ายไปอย่างไร เพราะมันหมายถึงการที่แอนน์บอกได้ว่า แซลลี่มีความเชื่อที่ไม่ตรงกับข้อเท็จจริง (ลูกบอลเปลี่ยนตำแหน่งไปแล้ว) และในกรณี ToMnet แสดงว่า มันรู้จักการกระทำของ AI ที่อยู่บนกระดาน แสดงว่ามันเข้าใจความคิดของ AI ที่อยู่ในตาราง

ToMnet บอกอะไรกับเรา

ถ้าเราอ่านพาดหัวข่าวจากสื่อ การรู้จักความคิดของจิตคนอื่นเทียบได้กับจิตของเด็กอายุ 4 ขวบ แต่ถ้าเราดูรายละเอียดการทดลองแล้วจะเห็นว่า การทดลองมีเงื่อนไขที่จำกัดมากๆ

การกระทำที่มาจากความคิดในจิต ถูกแทนด้วยตำแหน่งบนตาราง 11 คูณ 11 ช่อง แล้วความคิดที่มีจุดมุ่งหมายเป็นเพียงการเคลื่อนที่ไปหาตำแหน่งที่กำหนดไว้ ในความจริงแล้วมันแตกต่างกันอย่างมากกับการรู้จักจิตมนุษย์

ลองนึกถึงเกมที่แกล้งกันแล้วซ่อนกล้องไว้เพื่อดูปฏิกิริยาคนที่โดนแกล้ง จะเห็นว่าแม้แต่การตกใจของมนุษย์มีการแสดงออกแตกต่างกันเกินที่จะเดาได้ พฤติกรรมมนุษย์จริงๆ จึงเป็นเรื่องที่ห่างไกลจากตาราง 121 ช่องในการทดลอง

ถ้าหากจะนับประโยชน์ในทางวิศวกรรมหรือการสร้าง AI นี่ถือเป็นก้าวสำคัญที่ AI เรียนรู้ได้และประเมินการตัดสินใจของเครื่องจักรด้วยกันได้ แม้ว่าความสำเร็จนี้จะเป็นเพียงความสำเร็จในห้องทดลอง แต่ความสำเร็จนี้มีศักยภาพที่สำคัญคือ มันจะช่วยวิเคราะห์การทำงานของเครื่องจักรด้วยกันเอง และประเมินพฤติกรรมของ AI ในรูปแบบอื่นๆ

แต่นั่นก็ไม่ได้หมายความว่า ToMnet จะกลายเป็น Skynet แบบที่เรารู้จักจากหนังวิทยาศาสตร์ เพราะว่าการที่ ToMnet จะเรียนรู้ความคิดของ AI ตัวอื่นได้ มันจะต้องมีข้อมูลและรู้จักรูปแบบการทำงานของ AI ตัวอื่นเสียก่อน (ในกรณีนี้ก็คือ ToMnet จะต้องรู้จักว่า หน้าที่ของมันคือเรียนรู้ว่า AI จะเคลื่อนที่บนตาราง 121 ช่องนั้นอย่างไร) และการจะเป็น Skynet ได้ ไม่ใช่แค่ต้องเรียนรู้การทำงาน AI ตัวอื่น แต่มันจะต้องควบคุมการทำงานของ AI ตัวอื่นได้ด้วย ซึ่งนั่นก็ต้องอาศัยการออกแบบการทำงาน ToMnet เพิ่มเติมซึ่งไม่ได้อยู่ในขอบเขตการทดลองนี้ และจากรายงานก็จะเห็นว่า ToMnet ไม่ได้ออกแบบมาเพื่อให้สั่งการ AI ตัวอื่น

อย่างไรก็ตามข่าวนี้ถือว่าเป็นข่าวที่น่าติดตามและเป็นความก้าวหน้าที่สำคัญเพราะรูปแบบของ ToMnet อาจจะพัฒนากลายไปเป็นเหมือนตำรวจที่รายงานเราว่า AI ตัวไหนทำงานผิดพลาดหรือ AI ตัวไหนที่มีแนวโน้มจะสร้างปัญหาให้เราก็ได้

Tags: AI, DeepMind, ToMnet, Theory of Mind-Net, Daniel C. Dennett